Redes GAN: algoritmos que crean armas digitales

Las Redes Generativas Antagónicas (GAN) son algoritmos avanzados que, mediante la creación de deepfakes, desafían la seguridad digital de mujeres y niñas al exponerlas a nuevas formas de violencia en línea. Estas herramientas evidencian cómo los algoritmos perpetúan desigualdades y dinámicas de poder, haciendo urgente repensar su desarrollo desde una perspectiva ética para garantizar un entorno digital más justo y seguro.

Para entender cómo funcionan tecnologías complejas como las Redes GAN, primero debemos preguntarnos: ¿qué es un algoritmo?

Un algoritmo es un conjunto de pasos o instrucciones que un sistema sigue para realizar una tarea específica. Imagina que tienes instrucciones para armar un rompecabezas: cada paso está diseñado para ayudarte a colocar las piezas en su lugar hasta completar la imagen final. De manera similar, un algoritmo procesa información para alcanzar un resultado específico.

En el mundo digital, los algoritmos son la base de herramientas que usamos diariamente, como motores de búsqueda (Google o DuckDuckGo), redes sociales (X o Mastodon) y asistentes virtuales (Siri o Alexa). Mientras que plataformas como Google e Instagram priorizan algoritmos que personalizan contenidos basados en nuestros datos, alternativas como DuckDuckGo o Mastodon buscan ofrecer experiencias más privadas y descentralizadas. En ambos casos los algoritmos no son neutrales; detrás de ellos están las decisiones de quienes los diseñan, determinando qué priorizan, qué datos analizan y qué resultados generan. Esto hace que los algoritmos sean más que procesos técnicos, también influyen directamente en nuestras experiencias digitales.

IA y su relación con los algoritmos… ¿neutrales?

La inteligencia artificial (IA) es un campo de la tecnología que busca crear sistemas capaces de realizar tareas que, normalmente, requieren inteligencia humana, como reconocer patrones, tomar decisiones o incluso aprender. Para lograrlo, la IA se basa en algoritmos: instrucciones que procesan grandes cantidades de datos para llegar a un resultado.

Estas capacidades ya están integradas en herramientas que usamos diariamente. Algoritmos de IA están detrás de asistentes virtuales como Siri y Alexa, que procesan nuestras preguntas para ofrecer respuestas, o plataformas como Netflix, que nos recomiendan contenido según nuestros hábitos de consumo. Incluso, servicios como Google Translate utilizan estos algoritmos para analizar ejemplos y ofrecer traducciones precisas.

Aunque los algoritmos puedan parecer reglas matemáticas imparciales, la realidad es que no lo son. Detrás de cada algoritmo hay decisiones humanas: qué datos se incluyen o se excluyen, qué patrones se priorizan y qué objetivos se buscan alcanzar. Estas decisiones están influenciadas por las experiencias, valores y perspectivas de quienes los desarrollan. Por ejemplo, los algoritmos de redes sociales como Instagram o TikTok determinan qué contenido consideran “relevante” para cada usuario, pero ¿quién decide qué es relevante? Estas plataformas suelen optimizar sus algoritmos para maximizar el tiempo de uso, guiados por objetivos comerciales más que por un interés en ofrecer contenido diverso.

En redes sociales como X, el impacto de estas decisiones es aún más evidente. En 2023, se reveló que los tuits de Elon Musk aparecen en el apartado “Para ti” incluso para quienes no lo siguen. Esto no es casualidad: Musk ordenó cambios en el algoritmo para priorizar sus publicaciones, demostrando cómo el poder de quienes diseñan los algoritmos puede moldear la experiencia de millones de personas. Además, en octubre del año pasado, usuarios reportaron censura en la cuenta @PalestinaHoy: al intentar seguirla, el seguimiento se eliminaba automáticamente al salir del perfil. Este tipo de interferencias algorítmicas generan preguntas urgentes sobre quién controla la información que consumimos y qué narrativas se priorizan o silencian.

Este mismo criterio se aplica a tecnologías avanzadas como las Redes GAN. Aunque su funcionamiento parezca completamente técnico, el diseño de estas redes refleja las perspectivas de sus creadores y en la actualidad, de los equipos de desarrollo que las utilizan (para crear deepfakes, por ejemplo).

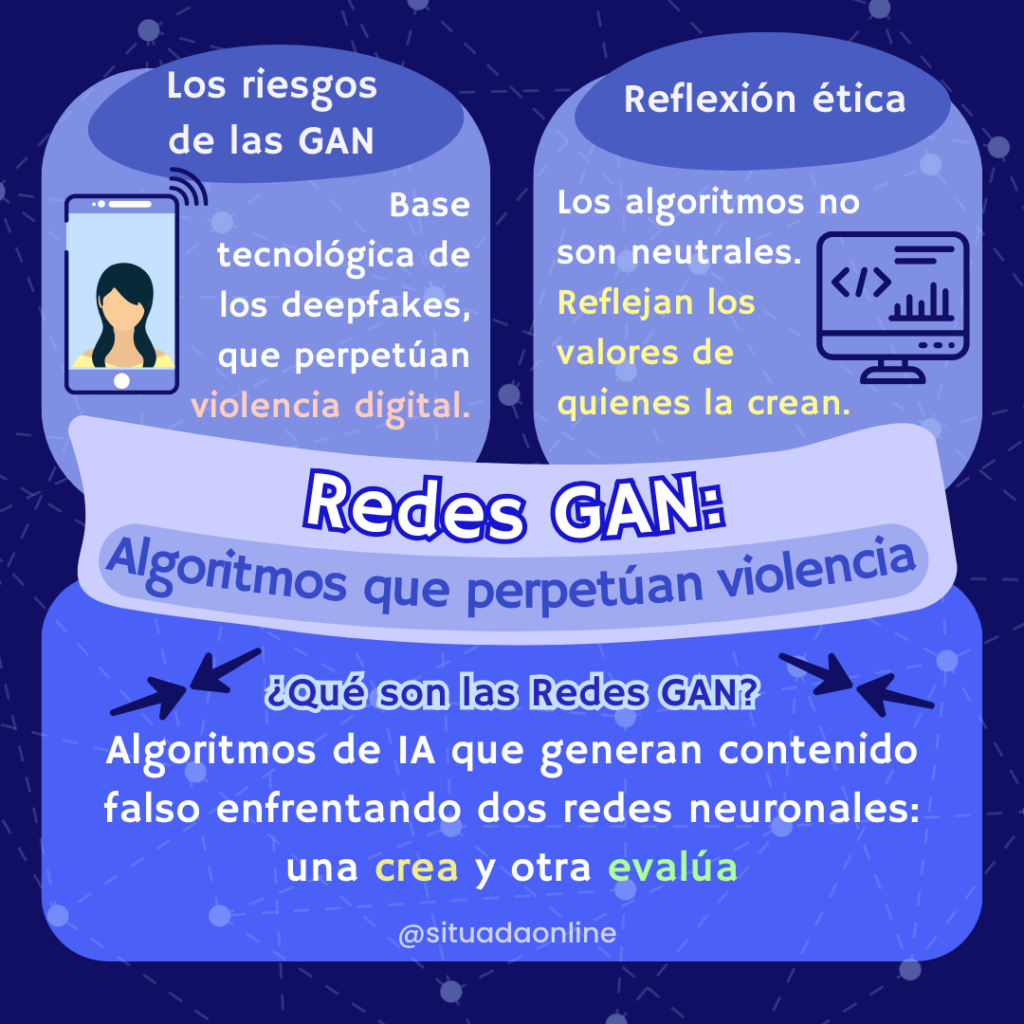

Redes Generativas Antagónicas (GAN)

Las redes GAN son un tipo de tecnología de inteligencia artificial desarrollada por Ian Goodfellow en 2014. Como todas las tecnologías de inteligencia artificial, las GAN funcionan gracias a algoritmos. En este caso, los algoritmos de las GAN están diseñados para aprender y crear contenido nuevo, como imágenes o videos, utilizando un subconjunto de la IA, llamado deep learning (aprendizaje profundo). Este enfoque, basado en redes neuronales, se inspira en cómo funciona el cerebro humano: procesando grandes cantidades de datos, identificando patrones y mejorando con la práctica.

Las GAN combinan dos redes neuronales que trabajan de manera adversarial:

- La red generativa: Es la encargada de crear datos falsos, como imágenes, videos o audios.

- La red discriminadora: Evalúa esos datos y determina si son reales o falsos.

Podemos imaginar este proceso como una dinámica entre una persona falsificadora y otra experta en detectar falsificaciones. La red generativa actúa como quien falsifica, intentando crear datos que engañen a la red discriminadora, que cumple el papel de quien evalúa críticamente. A medida que la red generativa mejora sus habilidades para engañar, la red discriminadora también se vuelve más exigente, generando un ciclo constante de mejora. Este proceso adversarial permite que las GAN produzcan contenidos sintéticos cada vez más realistas.

Fuente: https://redesinformaticas.org/red-gan/

Las GAN han sido utilizadas para crear desde imágenes de rostros humanos que no existen hasta paisajes artificiales que parecen sacados de una fotografía. Sin embargo, estas capacidades también han abierto la puerta a aplicaciones peligrosas, como los deepfakes.

Deepfakes vs. Redes GAN: la importancia de la distinción

Aunque los deepfakes y las Redes GAN están relacionados, no son lo mismo. Las GAN son una tecnología base que tiene aplicaciones en múltiples campos, mientras que los deepfakes son una de esas aplicaciones. Esta distinción es importante para evitar malentendidos que puedan presentar a los deepfakes como tecnologías de innovación, cuando en realidad son herramientas que, en la mayoría de los casos, perpetúan violencia de género, afectando desproporcionadamente a mujeres y niñas.

Si bien las GANs han sido utilizadas en ámbitos como la salud, donde generan imágenes médicas sintéticas para entrenar sistemas de inteligencia artificial, o en la agricultura, donde permiten analizar comportamientos en cultivos y ganado, es crucial no confundir estas aplicaciones con los deepfakes. Llamar a estos datos “deepfakes” es incorrecto y minimiza los peligros que el término deepfake conlleva, especialmente en su uso para violentar y desinformar.

Los deepfakes son una manifestación de cómo una tecnología puede ser utilizada como herramienta de control, explotación y desinformación. Desde la propagación de mentiras políticas hasta la humillación pública de mujeres mediante la creación de fotos o videos sexuales sin consentimiento, los deepfakes son un reflejo de cómo las dinámicas de poder se trasladan al entorno digital. El impacto de esta tecnología no es hipotético: muchas mujeres y niñas ya han sido víctimas, y su proliferación continuará si no se toman medidas.

Necesidad de la ética algorítmica

El espacio digital es una extensión de nuestra realidad, con sus desigualdades y dinámicas de poder. Por eso es importante entender que, actualmente, la tecnología responde principalmente a la lógica de la innovación y las decisiones políticas de grandes empresas.

El caso del creador de las GANs, ilustra esta desconexión entre la técnica y la ética. Lo que comenzó como una idea entre amigos evolucionó en una herramienta “útil”, pero sin prever los peligros que podría traer. Esto nos lleva a preguntas importantes: ¿qué realidades están priorizando las personas que diseñan estas tecnologías? ¿De quiénes son las experiencias y perspectivas que se reflejan en ellas?

Para que las tecnologías como las GANs sean realmente innovadoras, deben pensarse críticamente desde su concepción, no solo considerar capacidades técnicas. Crear y hacer uso de algoritmos que respeten a la humanidad no es una opción, es una responsabilidad. Solo así podremos construir un entorno digital justo y seguro para todas las personas.

Infografía

Redes GAN: algoritmos que perpetúan violencia

Noticias

XCC