Deepfakes: Tecnología al servicio de la violencia

Los deepfakes representan un desafío para la seguridad digital al manipular la realidad y perpetuar violencia digital de género, mediante inteligencia artificial. Esta tecnología amplifica desigualdades estructurales y expone a las personas, especialmente a las mujeres, a peligros en línea. En una era de manipulación masiva, urge reflexionar sobre cómo proteger la verdad, dignidad y derechos de las personas en el entorno digital.

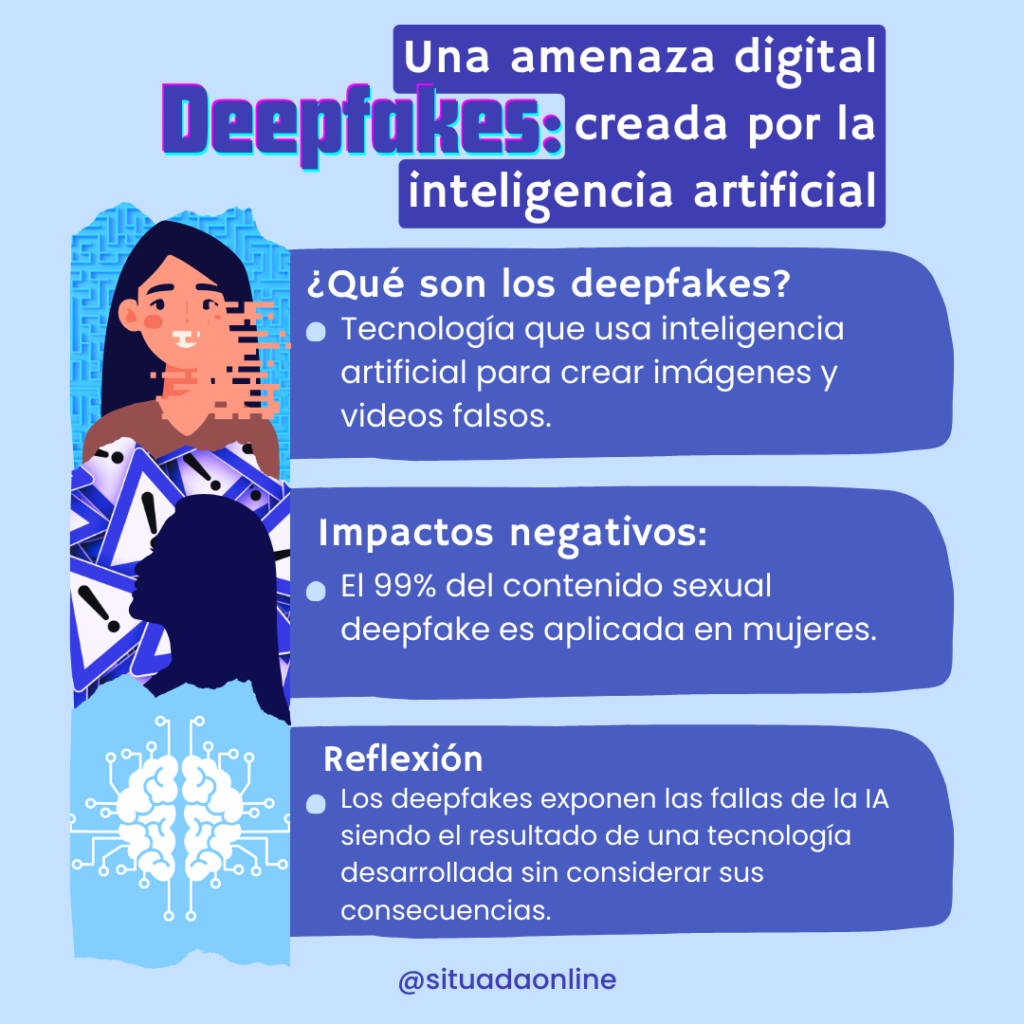

El término “deepfake” surge de la combinación de deep, que se refiere al aprendizaje profundo o deep learning (un área avanzada de la inteligencia artificial), y fake, que significa falso en inglés. Este término se refiere a contenidos digitales falsificados, como fotos o videos, creados mediante algoritmos de inteligencia artificial (IA) que replican patrones visuales y auditivos con un nivel de realismo asombroso.

El corazón de esta tecnología radica en las Redes Generativas Antagónicas (Generative Adversarial Networks, GANs), desarrolladas en 2014. Estas redes funcionan enfrentando dos algoritmos de IA: una que genera contenido falso y otra que lo evalúa. Este ciclo de retroalimentación permite crear resultados cada vez más convincentes.

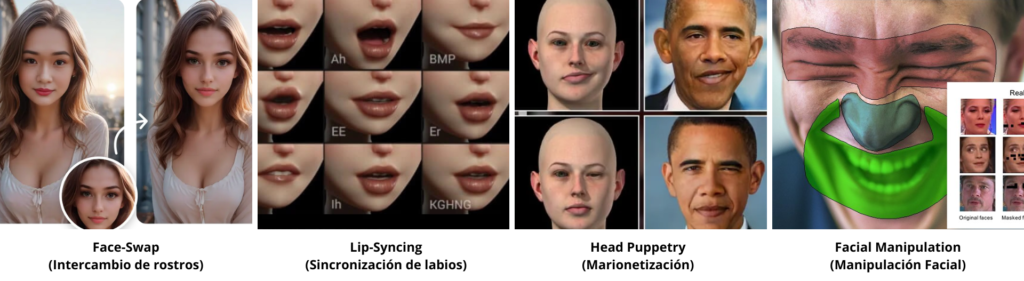

Los deepfakes tienen varias técnicas de aplicación: intercambian el rostro de una persona en el cuerpo de otra, sincronizan labios con audios que no fueron pronunciados por la persona, manipulan expresiones faciales y movimientos corporales para simular acciones que jamás ocurrieron. Su capacidad para engañar desafía nuestra confianza en lo que percibimos como real y abre una serie de interrogantes éticas.

Origen de los deepfakes

El nacimiento de los deepfakes se remonta al desarrollo de las Redes Generativas Antagónicas (GANs) por Ian Goodfellow en 2014, un avance que marcó un antes y un después en el campo de la inteligencia artificial. Según relata Goodfellow en varias entrevistas, la idea de las GANs surgió de una conversación con amigos en un bar de Montreal, que lo llevó a experimentar con código esa misma noche. El resultado fue una tecnología capaz de generar contenido visual y auditivo con un nivel de realismo nunca antes visto.

Sin embargo, este avance no estuvo acompañado de una reflexión profunda sobre sus posibles impactos sociales. Goodfellow admitió que su enfoque estaba en la tecnología misma, en lugar de las aplicaciones específicas o las consecuencias éticas de su creación, dejando en claro que no anticipó los riesgos asociados con la proliferación de los deepfakes, ni consideró cómo podrían ser utilizados contra los derechos de las personas, especialmente de las mujeres.

Más allá de reconocer los peligros, Goodfellow traspasó gran parte de la responsabilidad a las y los usuarios, sugiriendo que las soluciones deben basarse en la educación para fomentar el pensamiento crítico a través de clases de oratoria y debate. “En el discurso y el debate, compites contra otro estudiante”, señaló. “Piensas en cómo formular afirmaciones engañosas o cómo construir afirmaciones correctas que sean muy persuasivas”, agregó, refiriéndose a la detección de contenido falso. Sin embargo, los riesgos trascienden este ámbito, afectando múltiples aspectos de la vida social y personal.

Esta postura refleja una visión tecnocéntrica donde las innovaciones se diseñan priorizando la productividad, mientras que las implicaciones éticas quedan relegadas a un segundo plano. De esta reflexión surge una pregunta fundamental: ¿Puede la tecnología desarrollarse sin considerar de antemano el impacto, especialmente en un mundo donde las desigualdades estructurales amplifican sus riesgos?

Daños disfrazados de avances

En un mundo saturado de información, esta tecnología hace más difícil distinguir lo real de lo falso, creando un terreno fértil para la desinformación. También representa una amenaza para la estabilidad política y social, al facilitar la creación de discursos falsos o eventos inexistentes. Incluso figuras conocidas han promovido este tipo de contenidos. Un ejemplo de ello es Elon Musk, quien difundió un deepfake de Kamala Harris en X, en el que aparecía dando discursos que nunca pronunció.

Desde su aparición, los deepfakes han sido utilizados como herramientas de violencia digital, especialmente contra las mujeres. La popularización de esta tecnología comenzó en Reddit, donde un usuario llamado deepfakes creó videos falsos que mostraban a mujeres celebridades en situaciones sexuales (usando la técnica de face-swap). En la actualidad, el 99% del contenido sexual creado con esta tecnología está hecho sobre mujeres. Entre 2022 y 2023, la producción de este material aumentó un alarmante 464%.

La aplicación más utilizada de esta tecnología, y a su vez la más dañina, ha sido la creación de pornografía no consensuada, donde los rostros de mujeres son superpuestos en cuerpos de otras mujeres desnudas, exponiéndolas a humillaciones públicas, chantajes y transgresiones de su intimidad. Este uso inicial de la tecnología dejó claro que sus riesgos no eran solo hipotéticos, sino una realidad devastadora para muchas, especialmente en la región Latinoamericana.

Por otro lado, algunas voces argumentan que los deepfakes podrían tener usos positivos. Por ejemplo, en el ámbito artístico, se ha planteado la posibilidad de “revivir” a artistas fallecidos para recrear escenas y en la industria del marketing; reducir costos al permitir la creación de contenido audiovisual sin necesidad de rodajes complejos. Sin embargo, estas llamadas “ventajas” están lejos de ser incuestionables. Revivir digitalmente a una persona plantea dilemas éticos sobre el consentimiento y la explotación de su imagen. ¿Cómo garantizamos que esta práctica respete la memoria y dignidad de quienes ya no están? ¿Quién decide cómo y por qué se utiliza su imagen?

Un reflejo de las dinámicas de poder en la era digital

Más allá de sus aplicaciones técnicas, los deepfakes revelan algo más profundo: la forma en que la tecnología es creada y utilizada dentro de estructuras de poder desiguales. Mientras que sus supuestos beneficios permanecen llenos de incertidumbres éticas, sus impactos negativos son innegables, especialmente para las mujeres, quienes continúan siendo el blanco principal de la violencia digital que perpetúa dinámicas históricas de opresión.

Esta tecnología demuestra que las herramientas digitales no son neutrales. Los deepfakes van más allá de su concepto (manipular imágenes), sino que exponen las prioridades y perspectivas de quienes las crean, evidenciando cómo las desigualdades existentes encuentran nuevos vehículos en el entorno digital. En lugar de promover la equidad, el desarrollo tecnológico amplifica vulnerabilidades y refuerza jerarquías de poder cuando no se diseñan con ética y consciencia.

El problema no radica únicamente en los usos malintencionados de los deepfakes, sino en las prioridades mismas de su creación. Tecnologías como ésta reflejan una lógica que privilegia la productividad y el impacto comercial, mientras minimiza sus consecuencias. En este contexto, las personas más vulnerables se convierten en terreno de experimentación, en lugar de ser protegidas.

Si queremos que la tecnología contribuya a la seguridad y progreso colectivo, es fundamental repensar sus objetivos y los valores que guían su desarrollo.

Deepfakes: El rostro de la nueva amenaza digital

Noticias

XCC